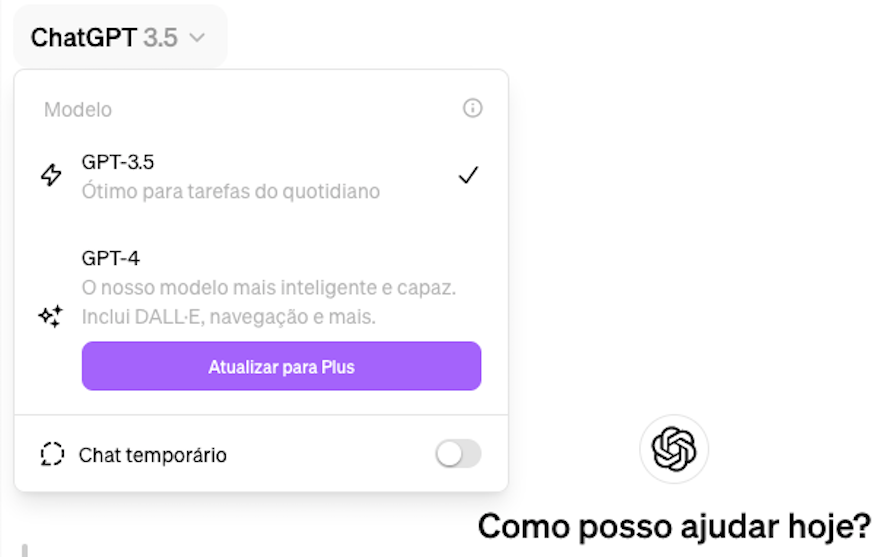

Chama-se GPT-4o (o ‘o’ significa ‘omni’, uma palavra em latim que significa ‘total’, ‘tudo’) e é o novo modelo de inteligência artificial que passa a ficar disponível em conjunto com o GPT-3.5 (que se mantém totalmente gratuito) e o GPT-4 (a versão paga do serviço da OpenAI).

Segundo a empresa, que apresentou este novo modelo de linguagem hoje ao princípio da manhã nos EUA (final da tarde, em Portugal), numa keynote liderada pela CTO, Muri Murati, o «GPT-4o tem inteligência de nível GPT-4, mas melhora as capacidades» mas está um nível acima, ao pode ser usado com interacções de «texto, áudio e reconhecimento de imagens».

Para Muri Murati, o GPT-4o raciocina em «voz, texto e visão», um upgrade «incrivelmente importante», que nos faz olhar «para o futuro da interação entre nós e as máquinas».

Dias antes desta apresentação, surgiu o rumor de que a OpenAI iria lançar um motor de busca para rivalizar com a Google, mas isto acabou por não acontecer. Também houve a teoria de que a empresa estava a preparar um assistente de voz muito parecido com Samantha, a IA do sistema operativo que aparece no filme Her.

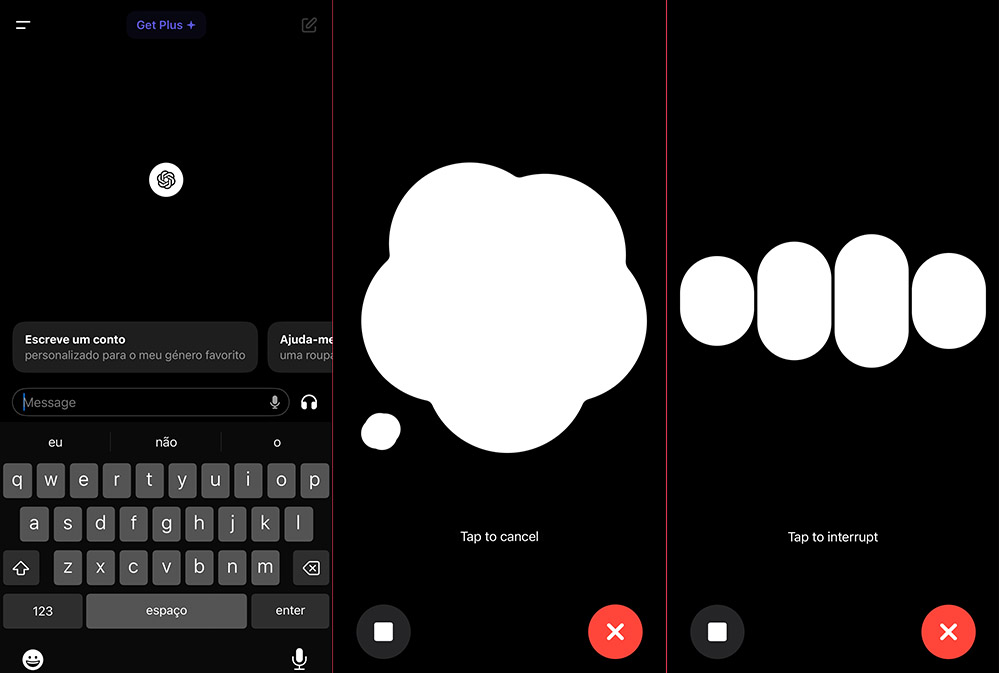

E esta última previsão acaba por estar mais próxima da realidade, uma vez que um dos upgrades do ChatGPT-4o tem que ver com a capacidade de interagir com esta IA através de voz. Isto já pode ser feito na app para iOS (foto em baixo), em que basta tocar no ícone dos auscultadores que está no canto inferior direito da interface principal, para entrar num modo em que podemos perguntar (e conversar) coisas e receber respostas de voz.

A mesma resposta é transcrita em texto, mas a forma como o ChatGPT-4o fala connosco não é uma simples versão do que é escrito, como algumas IA que se limitam a ler de forma algo robótica o texto que pedimos. Aqui, o recurso da OpenAI é muito mais natural, muito na linha do que acontece com a Siri ou o Assistente Google… mas com um twist.

«O ChatGPT-4o pode, até, captar a emoção na voz de um utilizador e gerar voz numa gama de diferentes estilos emotivos». Ora, esta era precisamente uma das características de Samantha, no filme Her, que lhe dava um toque humano.

A outra grande actualização é a capacidade de mostrar uma imagem ao ChatGPT-4o e pedir-lhe que a analise, para chegar a conclusões: entre as possibilidades estão, entre outras, mostrar um screenshot de código HTML ou perguntar à IA algo que esteja errado.

Neste momento, o ChatGPT-4o ainda não está disponível em Portugal, via browser, mas na app já é possível “conversar”. Uma vez que a OpenAI diz que este upgrade chegará a todos os utilizadores de forma progressiva, é natural que em breve (talvez até ao final de Maio) seja possível testar estas capacidades in loco.

Quando tudo ficar disponível, o ChatGPT gratuito entrará mesmo noutra era: com conhecimentos do mundo até Outubro de 2023, vai ser possível usar este novo modelo de forma pré-definida (ou seja, será o serviço-padrão para qualquer utilizador não-pagante).

Contudo, há uma ressalva: as mensagens que podem ser trocadas mensalmente têm um limite (a OpenAI não disse quantas, apenas que «variará com base na utilização e procura actuais») e, quando este “plafond” acabar, o ChatGPT-3.5 passa a ser a IA padrão.